#МедичнаПросвіта: Як уникнути ризиків під час спілкування з чатботами зі штучним інтелектом

Відповідно до статистичних даних, понад 3 млрд людей у світі щомісяця використовують ChatGPT, а психологічна підтримка та спілкування входять до найпоширеніших причин звернення до цього сервісу. Чому чатботи зі штучним інтелектом (ШІ) дедалі частіше стають для людей джерелом емоційної підтримки, чи може ШІ замінити емпатію, живе спілкування, які ризики становить спілкування з чатботами та як їх уникнути розповідає завідувачка кафедри медичної психології, психосоматичної медицини та психотерапії Національного медичного університету імені О.О. Богомольця, професорка Олена Хаустова.

Так, для багатьох користувачів тривалі діалоги з ШІ стають важливою частиною повсякденного життя. Людей приваблює насамперед доступність, оскільки чатбот «завжди онлайн», швидко відповідає, не потребує запису, може бути дешевшим або безоплатним, а ще дає відчуття анонімності й меншого страху осуду. Для частини користувачів важлива також «низька пороговість», зокрема легше почати розмову з ботом, ніж одразу звернутися до фахівця чи близьких, особливо коли є сором, стигма або втома. Дослідження цифрових розмовних агентів у сфері ментального здоров’я показують, що такі інструменти можуть зменшувати суб’єктивний дистрес і бути прийнятними для користувачів, особливо як допоміжний короткостроковий ресурс (психоосвіта, вправи, самоспостереження), але це не тотожне повноцінному лікуванню.

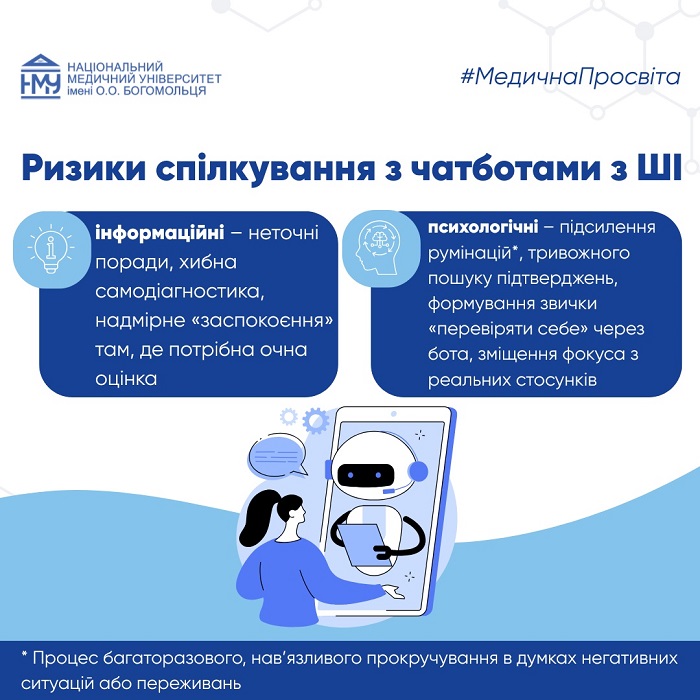

Так, чатбот із ШІ не може замінити лікаря чи контакти з людьми, бо лікування – це не лише «текстова порада». Лікар / психолог працює з контекстом життя, проводить клінічну оцінку, враховує ризики, супутні стани, медикаменти, відповідальність за рішення, а також будує терапевтичні стосунки, де є емпатія, межі, професійна етика й безпека. Чатбот може помилятися, довигадувати факти, не бачить невербальних сигналів, не має доступу до повної медичної інформації та не здатен гарантувати кризове реагування. Саме тому авторитетні професійні джерела наголошують на потребі «запобіжників» і підкреслюють: ШІ може бути інструментом, але не заміною фахівця та живої підтримки.

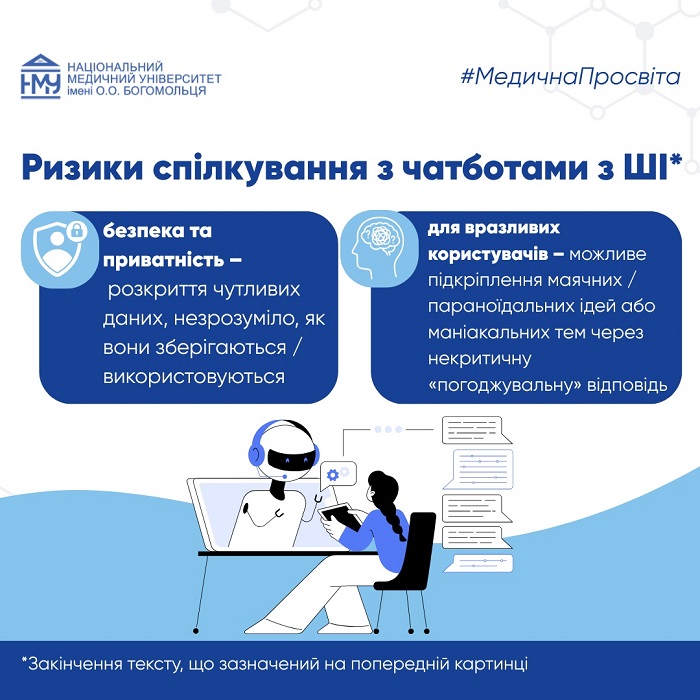

У науковій та клінічній літературі вже описуються випадки й обговорення, де інтенсивне користування чатботом за певних умов (високий стрес, ізоляція, недосип) могло посилювати психотичні переживання або дезорганізовувати сприйняття. Але важливо підкреслити – це не означає, що чатботи «викликають психоз», у всіх мова йде про ризики у вразливих ситуаціях і про потребу обережності.

Згідно з дослідженнями, особливо вразливою під час спілкування з чатботами зі штучним інтелектом є молодь. Зокрема, третина підлітків використовує ШІ для соціальної взаємодії, кожен третій обрав би його замість людини для серйозних розмов, а кожен десятий вважає розмови з ботом ефективнішими та доступнішими, ніж спілкування з людьми. В одному з випусків Британського медичного журналу (BMJ) автори статті попереджають, що надалі людство може спостерігати формування покоління, яке вчиться створювати емоційні звʼязки з сутностями, що лише імітують свідомість.

Нерідко громадяни запитують, чи справді необхідно обмежити часте спілкування з чатботами з ШІ дітям, підліткам і людям із сімейною історією психозу, шизофренії чи біполярного розладу? Варто зазначити, що ідея обмеження має під собою раціональні підстави, але її варто формулювати коректно: не «заборона», а підвищена обережність і межі. Згідно із професійними рекомендаціями, підлітки частіше, ніж дорослі, та менш критично оцінюють точність / наміри бота. Також існує ризик, що «псевдостосунки» з ШІ можуть витісняти розвиток реальних соціальних навичок і підтримки. Для людей зі схильністю до психотичних розладів (у т.ч. сімейний анамнез, продромальні симптоми) ризик полягає в тому, що генеративний ШІ інколи може підтверджувати хибні переконання або «підживлювати» нездорові інтерпретації, що в літературі прямо обговорюється як потенційний механізм шкоди для вразливих осіб.

Щодо людей без попередніх діагнозів: власне користування ботом не дорівнює хворобі, але надмірність (нічні «марафони», ізоляція, недосип, заміна живих контактів) може погіршувати сон, тривожність і стресостійкість, а це вже може «розхитувати» психічний стан у будь-кого.

Про проблемне використання чатботів із ШІ говоримо тоді, коли з’являються втрата контролю (не виходить скоротити час), пріоритетність (чатбот важливіший за навчання / роботу /сон / спілкування) і наслідки (падає успішність, зростає конфліктність, порушується сон, підвищується тривожність без бота). Типові сигнали: постійне «переуточнення» у бота, компульсивне повернення до діалогів, використання чатбота як єдиного «регулятора емоцій», уникання живих контактів, дратівливість у разі обмеження доступу.

Звертатися по фахову допомогу варто, якщо є помітне погіршення функціонування, стійке безсоння, панічні стани, наростання підозріливості / параноїдних інтерпретацій, або якщо людина починає сприймати відповіді бота як «остаточну істину» і приймає важливі рішення лише на їх основі.

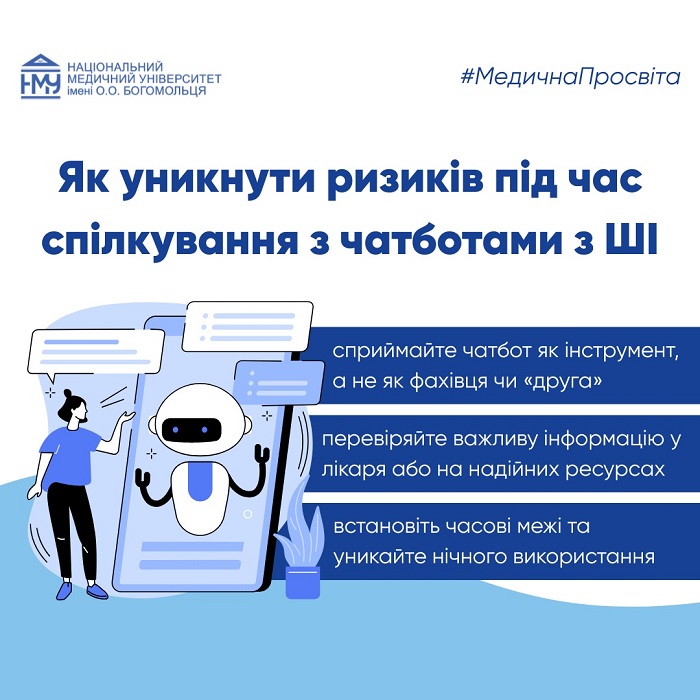

Щоб уникнути ризиків під час спілкування з чатботами з ШІ:

- сприймайте чатбот як інструмент, а не як фахівця чи «друга»;

- перевіряйте важливу інформацію (медицина / ліки / діагнози) у лікаря або на надійних ресурсах;

- встановіть часові межі та уникайте нічного використання — недосип різко підвищує вразливість психіки;

- не підміняйте ботами живу підтримку: домовтеся із собою, що за тривожних/депресивних симптомів спершу пишете близькій людині або фахівцю;

- не діліться персональними й медичними даними, які не готові бачити в чужих руках;

- якщо є схильність до тривоги, нав’язливостей або психотичних переживань — користуйтеся коротко, структуровано (наприклад, 10-15 хв на вправу / план), а не «нескінеченною розмовою».

Такі підходи узгоджуються з професійними порадами щодо підліткової безпеки та загальних «запобіжників» під час використання ШІ.

Чатбот із ШІ може стати частиною психологічної терапії, але як додаток, а не як заміна терапії. У структурованому форматі чатбот може допомагати з психоосвітою, нагадуваннями про домашні завдання, простими КПТ-вправами (когнітивно-поведінкова терапія), трекінгом симптомів і підтримкою між сесіями – особливо, коли доступ до фахівця обмежений. Ефективність розмовних агентів у певних дослідженнях і оглядах виглядає обнадійливою для зниження дистресу, проте автори одночасно підкреслюють потребу в стандартах безпеки, контролі якості й чітких межах застосування.

Якщо говорити про застосовування в Україні чатботів зі штучним інтелектом для психологічної підтримки, то публічні приклади цифрових рішень існують (зокрема сервіси, що позиціонують ШІ як психологічну підтримку, та медико-психологічні застосунки). Але єдиного «офіційного» показника частоти використання саме чатботів із ШІ в терапії наразі важко назвати без спеціальних національних реєстрів / моніторингів. На тлі високого запиту й бар’єрів доступу до допомоги в умовах війни (вартість, доступність, стигма) цифрові формати можуть поширюватися, однак їхня інтеграція в клінічну практику має відбуватися обережно й з опорою на доказовість та етичні стандарти.

Нагадаємо, що фахівці НМУ імені О.О. Богомольця розробили соціальні платформи, завдяки яким можна отримати безоплатні психологічні консультації, а також оформити заявку на індивідуальну консультацію психолога.

Реєстрація заявок на індивідуальні консультації – Психологічна підтримка студентам, інтернам та колективу НМУ імені О.О. Богомольця (google.com)

Registration of applications for individual consultations – Psychological support for Bogomolets National Medical University students, interns and staff (google.com)

Чатбот першої психологічної допомоги в телеграмі – Telegram: Contact @friend_first_aid_bot

Авторка: завідувачка кафедри медичної психології, психосоматичної медицини та психотерапії

Національного медичного університету імені О.О. Богомольця, професорка Олена Хаустова

Інфографіка: Центр комунікацій, організаційної і редакційної роботи